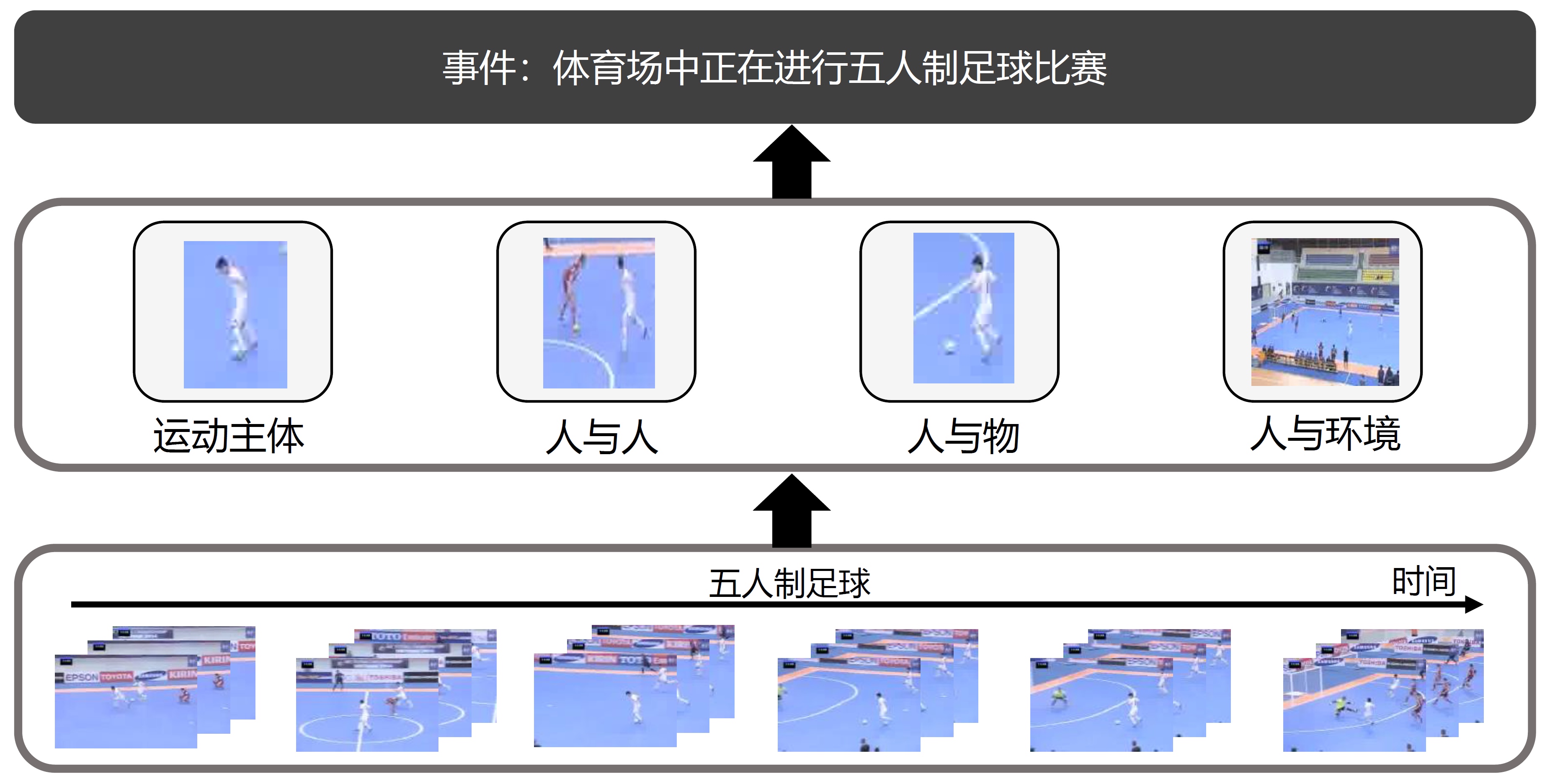

视频行为理解通过算法分析视频中运动主体、人与人、人与物体、人与环境之间关系,理解视频中人的动作和行为,结合视频的时序信息进一步理解视频中发生的事件。我们主要专注于其中的视频动作识别、时序动作检测、时空动作检测和原子动作分割四个子任务。

图1. 视频行为理解示意图

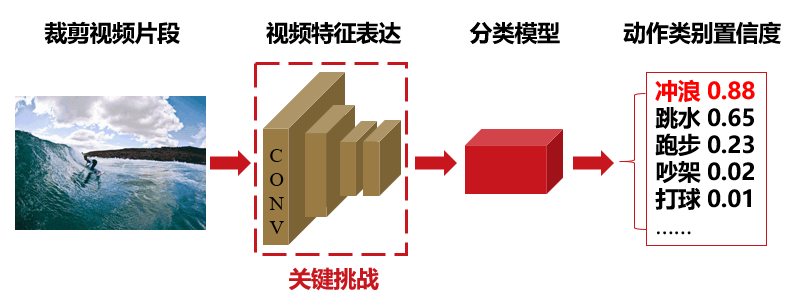

1. 视频动作识别是视频行为理解中一个基础任务,可以服务于下游时序动作检测以及时空动作检测任务。视频动作识别是在一段已裁剪的视频中识别出动作类别,并给出动作类别置信度。其核心是视频特征表达,通常利用光流图像和视频图像提取视频中的运动信息和表观信息。我们致力于更高效、更有效地提取视频特征,我们寻求在视频层面对视频特征在空间层面和时序层面解耦,提高视频特征的可解释性;同时,我们针对3D卷积参数量巨大问题,利用卷积核结构分解降低模型参数量,提高模型计算效率。

图2. 视频动作识别示意图

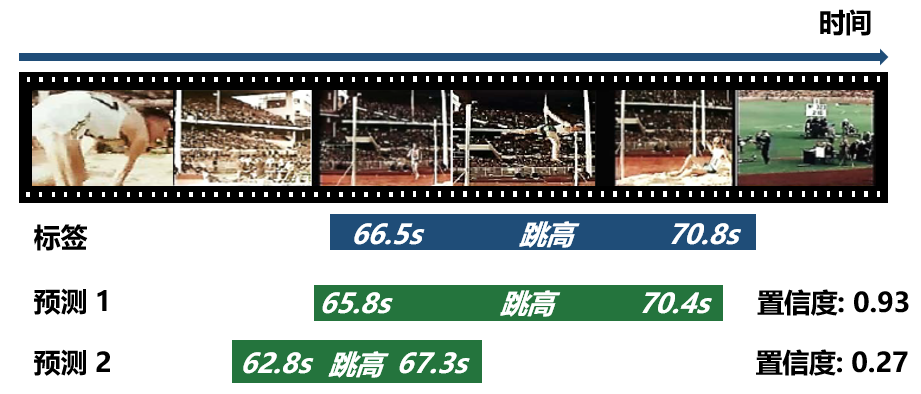

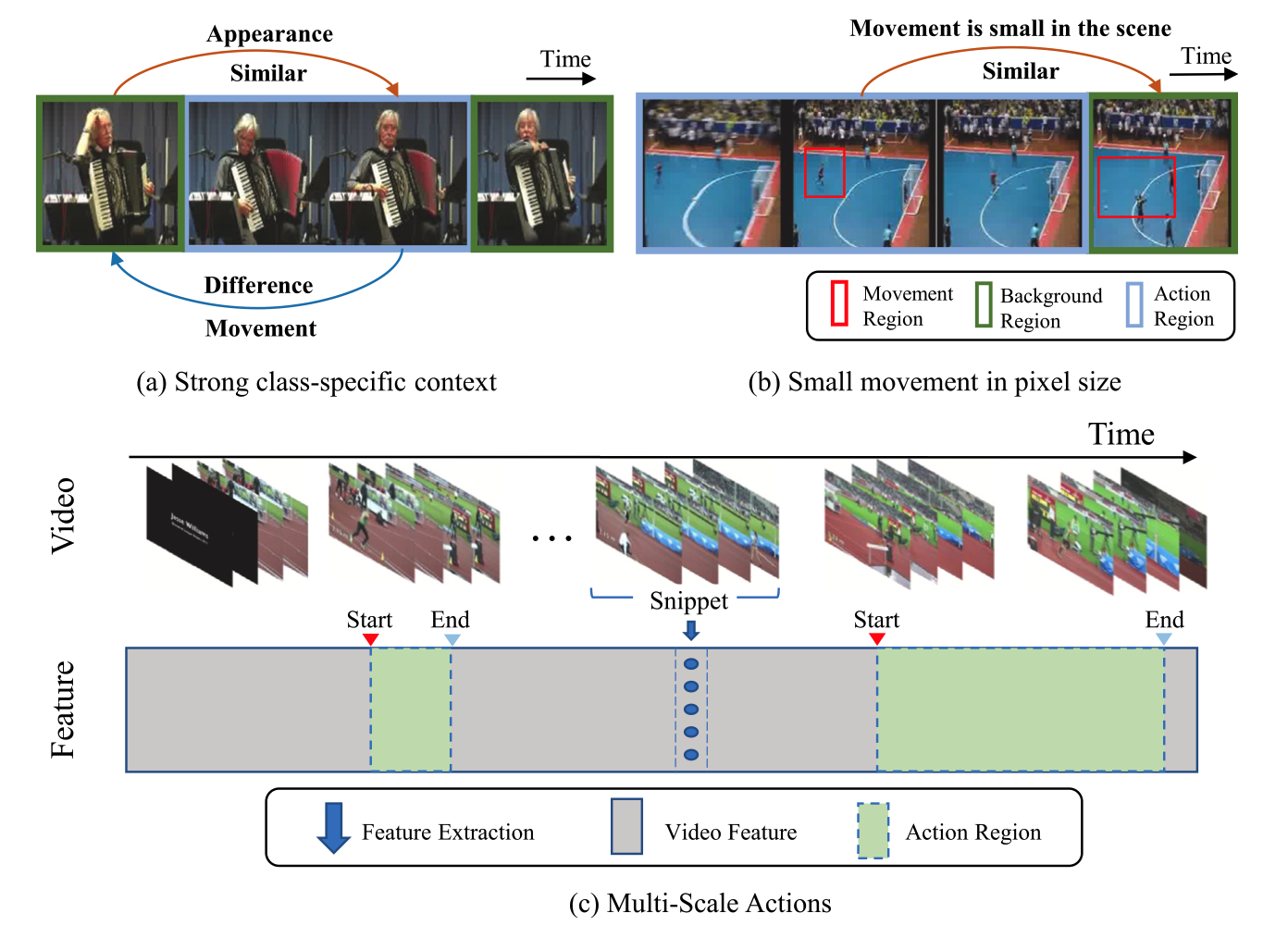

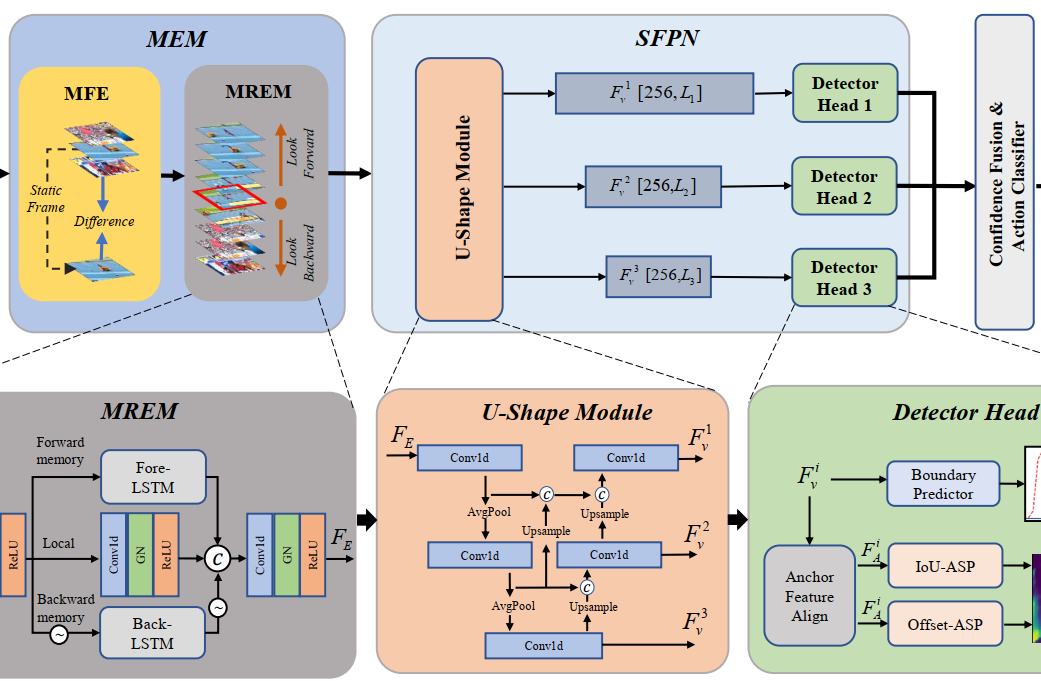

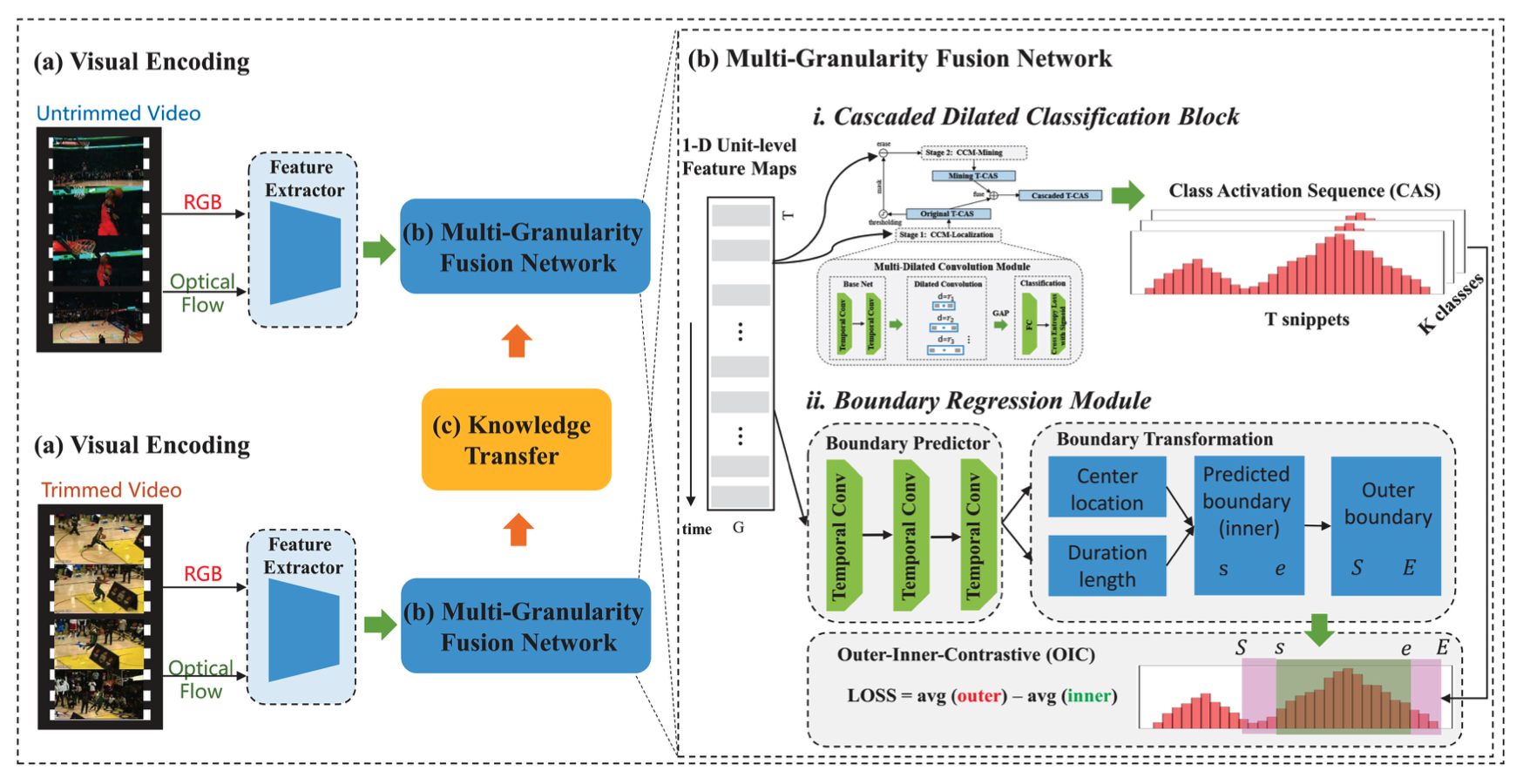

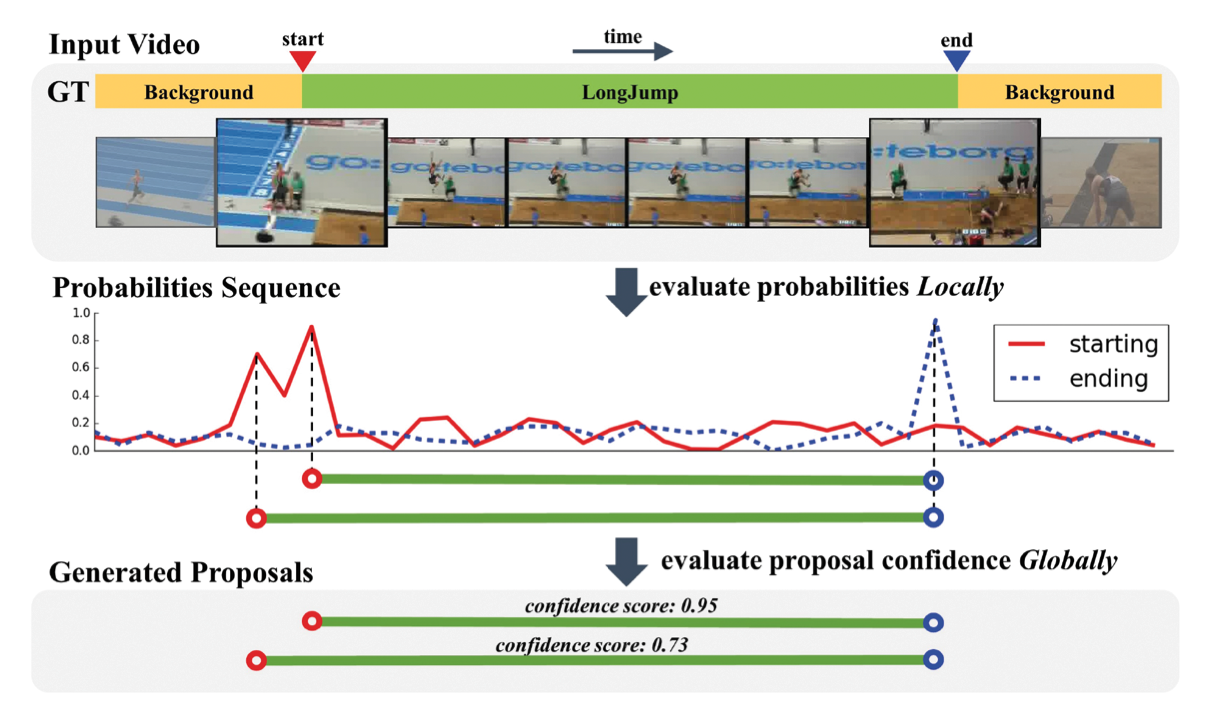

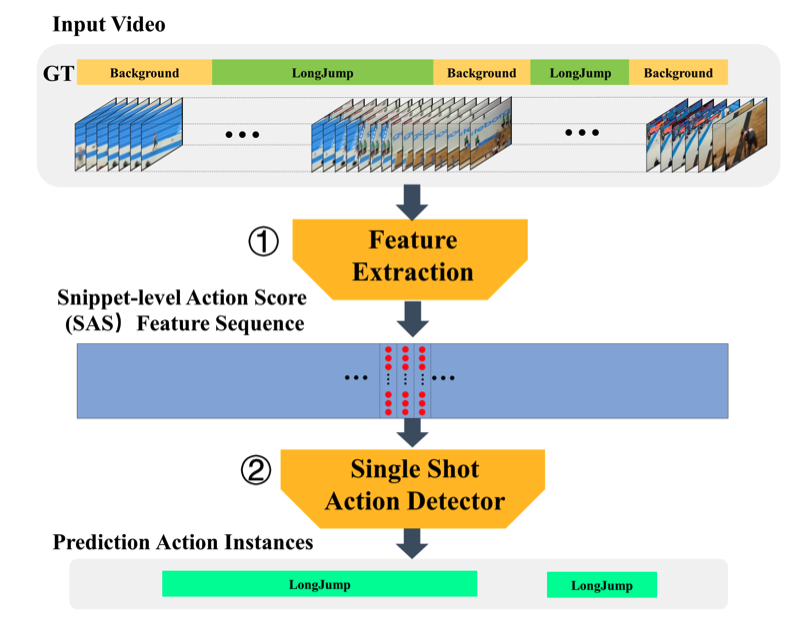

2. 时序动作检测是在未裁剪的原始视频中定位出动作出现的时序边界,并给出动作片段对应动作类别。时序动作检测在视频剪辑、视频推荐、只能监控中存在重要的应用价值。我们致力于建立更准确的动作边界描述,生成高质量的动作提名片段,为了提出更准确的动作片段,我们提出了更灵活的时序动作检测框架。此外,针对动作边界的模糊性,在视频特征表达中学习边界特征表达,突出视频动作前景和背景之间差异性。

图3. 时序动作检测示意图

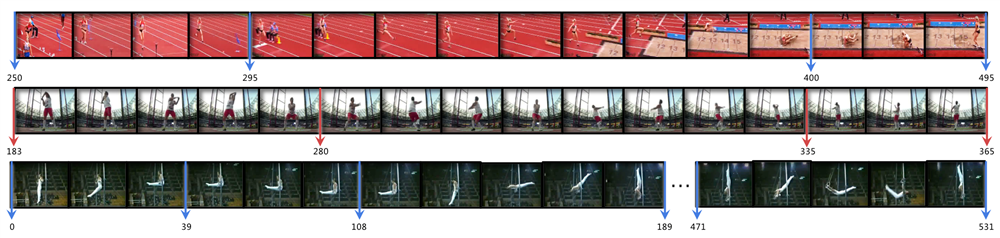

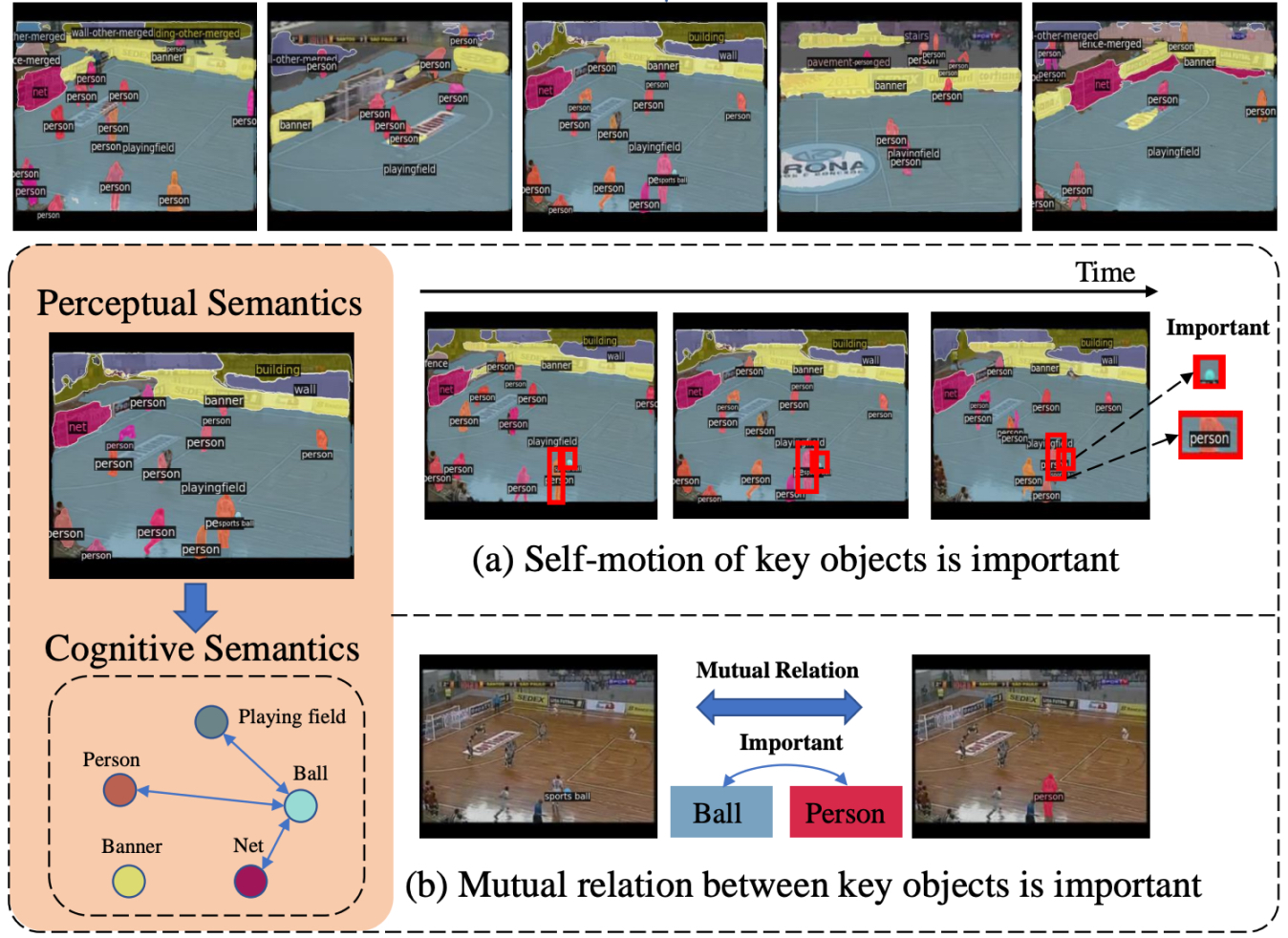

3. 时空动作检测作为视频行为理解领域的一个重要研究方向,其任务目标是同时在时间和空间上对视频中的兴趣动作进行定位和识别,对理解动作在视频中的时空演进模式有着重要的意义。与单纯在时间上检测出动作的开始、结束时间相比,每一帧上动作主体空间位置的检测为该研究方向的实际应用提供了更广阔的实用前景。在现有的帧级和片段级时空动作检测的基础上,我们专注于提升模型的多任务特征学习能力、改进动作建模效果,同时,我们也探索了数据稀缺场景下时空动作检测的半监督学习方法。

图4. 时空动作检测演示视频

4. 原子动作分割是理解复杂动作间时序关系的重要步骤,它的目标是在无监督的情况下将一个完整动作在时序上划分成若干个原子动作,这些按时间顺序排列的原子动作构成了对原始动作时序上的精简表示和语义上的完整描述。相比于时序动作分割在一个事件下对动作的粗略划分,无监督的原子动作对原始动作的划分具有更高的细粒度,这将对提升动作识别、动作检测中动作建模能力的提升产生正向的促进作用。以深度学习为基础,我们着手提升无监督原子动作分割中的特征表示能力和原子动作间时序关系的建模能力。此外,我们也关注原子动作分割与后续视频理解任务的结合。

图5. 原子动作分割示意图

主要相关论文

|

|

Pattern Recognition 2024 [BibTex] |

|

Movement Enhancement toward Multi-Scale Video Feature Representation for Temporal Action Detection |

|

IEEE Transactions on Multimedia 2021 [BibTex] |

|

BSN: Boundary Sensitive Network for Temporal Action Proposal Generation ECCV 2018 [BibTex] |

|

Single Shot Temporal Action Detection ACM MM 2017 [BibTex] |